Project Soli: un reloj aún más inteligente

21 mayo, 2016

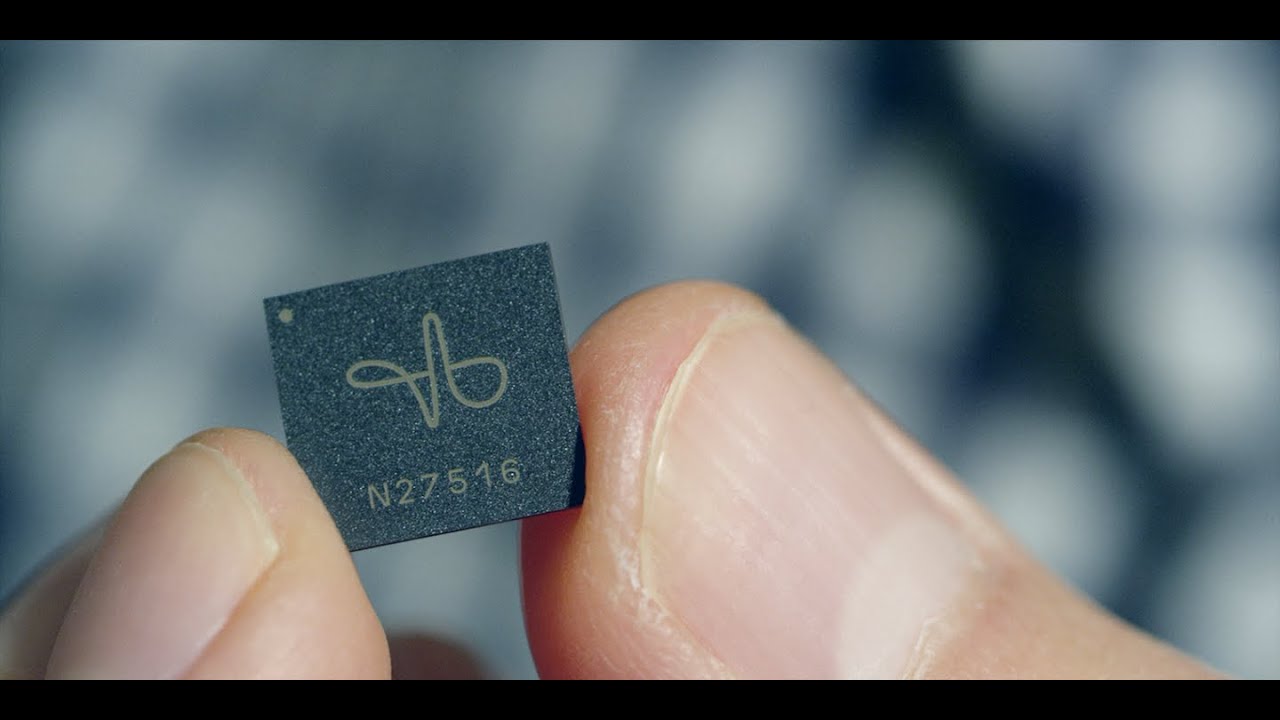

Google sigue innovando y presentando novedades. Esta vez nos ha enseñado algo de lo que no hemos oído hablar mucho, el Proyecto Soli, un nuevo sistema de interactuar con los objetos sin tener que tocarlo a través de nuestras manos.

Esta función es posible gracias a la tecnología de un radar que determina la posición de tus manos en el espacio pudiendo detectar movimientos específicos para ejecutar algunas acciones. Esta tecnología fue desarrollada específicamente para wearables.

Google Assistant: la unión perfecta entre Google y usuarios

Algunos desarrollados pudieron probar esta función, percatándose de su enorme gasto energético. Pero Google reveló en el I/O de este año que habían dado un gran paso en el apartado energético, haciendo posible que se pueda implementar en un smartwatch.

Una solución para las pantalla de los wearables

Como vemos en el vídeo, este proyecto va a cambiar la forma de interactuar con los objetos. Con unos simples movimientos con las manos podrás encender un altavoz o ver un mensaje en tu smartwatch sin necesidad de que haya contacto físico. Esta función va a hacer que, el navegar por la interfaz de un smartwatch con una pantalla pequeña no sea un problema.

El equipo que está trabajando en el Proyecto Soli nos enseñó que en el futuro esta tecnología no estará destinado solo a wearables, Una gran cantidad de objetos podrán utilizar esta nueva función. La idea de poder interactuar con todos los aparatos electrónicos que hay en tu casa sin necesidad de moverte del sitio podría ser posible gracias a esto.

Seguramente esta tecnología tarde en llegar, por lo pronto Google ha planeado lanzar una nueva versión para desarrolladores en el próximo año que, seguramente, siga en fase beta. Pinta muy bien este proyecto, pero habrá que esperar a ver como prospera en los próximos años y en cuando llegará al consumidor para un uso cotidiano.

Project Ara y los smartphones modulares de Google llegaran en 2017

FUENTES | Project Soli